Nginx高可用,如何实现IP跳跃/IP漫游?

本文目录

尼恩说在前面

nginx-keepalived的高可用方案

Keepalived是什么?

VRRP虚拟路由冗余协议

- VRRP协议的来源

- VRRP的核心概念

- VRRP协议的来源

虚拟路由器

- VRRP路由器(物理实体)

- 虚拟路由器:

- 主控路由器主路由器(MASTER):

- 题外话:ARP协议

- ARP协议工作过程

VRRP协议选举机制

选举流程

Keepalived体系结构

IPVS内核模块

Keepalived对服务器运行状态和故障隔离的工作原理

- 网络层:

- 传输层:

- 应用层:

Keepalived + Nginx 系统架构

- 系统环境

keepalive的配置文件

部署架构

离线部署keepalived

编写nginx的监控脚本

修改keepalived配置

重启 keepalive服务

查看IP

访问高可用代理后的nacos

第2个节点,第3个节点离线部署keepalived

复制文件/并且安装

重启 keepalive服务

查看IP地址

测试高可用

-访问vip的ng

-访问vip的nacos (假设已经安装nacos)

-访问高可用代理的minio(假设已经安装minio)

- 说在最后

nginx-keepalived的高可用方案

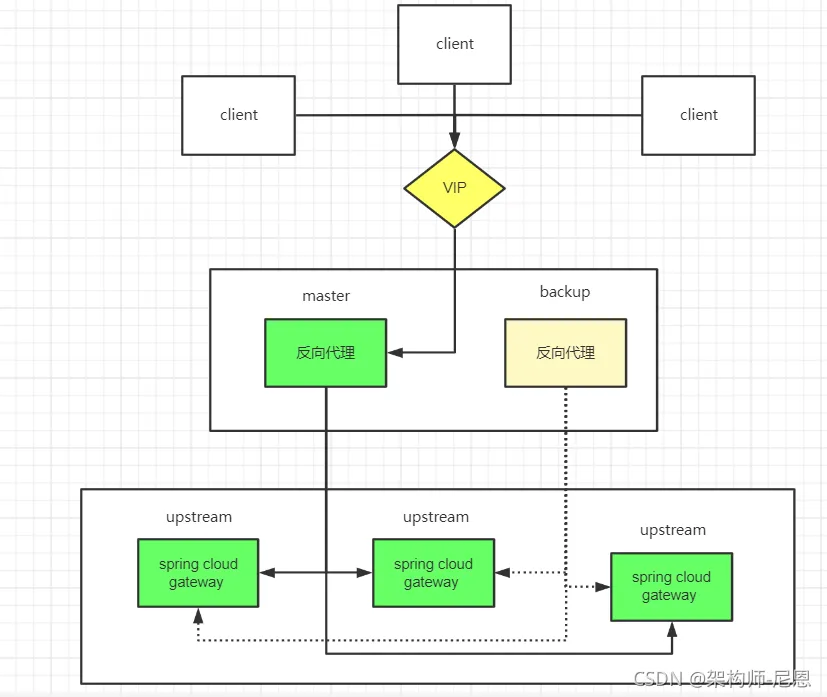

我们使用 nginx-keepalived双机热备机制,vip主机可以进行漂移,这样主机挂掉了,还有备用机可以顶上

具体的vip漂移架构图,如下:

Keepalived是什么?

Keepalived起初是为LVS设计的,专门用来监控集群系统中各个服务节点的状态,

Keepalived 是一款轻量级HA集群应用,它的设计初衷是为了做LVS集群的HA,即探测LVS健康情况,从而进行主备切换,不仅如此,还能够探测LVS代理的后端主机的健康状况,动态修改LVS转发规则。

当LVS进行主备切换的时候,对外提供服务的IP是如何做到切换的呢?

这就依赖于keepalived 所应用的vrrp协议,即Virtual Reduntant Routing Protocol,虚拟冗余路由协议。简单来讲,此协议是将IP设置在虚拟接口之上,根据一定的规则实现IP在物理主机上流动,即哪台主机可以占有该IP。

而且keepalived具有脚本调用接口,可通过脚本完成拓展功能。

它根据TCP/IP参考模型的第三、第四层、第五层交换机制检测每个服务节点的状态,如果某个服务器节点出现异常,或者工作出现故障,Keepalived将检测到,并将出现的故障的服务器节点从集群系统中剔除,这些工作全部是自动完成的,不需要人工干涉,需要人工完成的只是修复出现故障的服务节点。

后来Keepalived又加入了VRRP的功能,VRRP(VritrualRouterRedundancyProtocol,虚拟路由冗余协议)出现的目的是解决静态路由出现的单点故障问题,通过VRRP可以实现网络不间断稳定运行,因此Keepalvied一方面具有服务器状态检测和故障隔离功能,另外一方面也有HAcluster功能。

健康检查和失败切换是keepalived的两大核心功能。所谓的健康检查,就是采用tcp三次握手,icmp请求,http请求,udp echo请求等方式对负载均衡器后面的实际的服务器(通常是承载真实业务的服务器)进行保活;而失败切换主要是应用于配置了主备模式的负载均衡器,利用VRRP维持主备负载均衡器的心跳,当主负载均衡器出现问题时,由备负载均衡器承载对应的业务,从而在最大限度上减少流量损失,并提供服务的稳定性。

VRRP虚拟路由冗余协议

虚拟路由冗余协议(Virtual Router Redundancy Protocol,简称VRRP)是由IETF提出的解决局域网中配置静态网关出现单点失效现象的路由协议,1998年已推出正式的RFC2338协议标准。

VRRP广泛应用在边缘网络中,它的设计目标是支持特定情况下IP数据流量失败转移不会引起混乱,允许主机使用单路由器,以及即使在实际第一跳路由器使用失败的情形下仍能够维护路由器间的连通性。

VRRP协议的来源

在现实的网络环境中。主机之间的通信都是通过配置静态路由或者(默认网关)来完成的,而主机之间的路由器一旦发生故障,通信就会失效,因此这种通信模式当中,路由器就成了一个单点瓶颈,为了解决这个问题,就引入了VRRP协议。

VRRP的核心概念

VRRP是一种路由容错协议,也可以叫做备份路由协议。

在VRRP协议中,有两组重要的概念:

- VRRP路由器和虚拟路由器

- 主控路由器和备份路由器

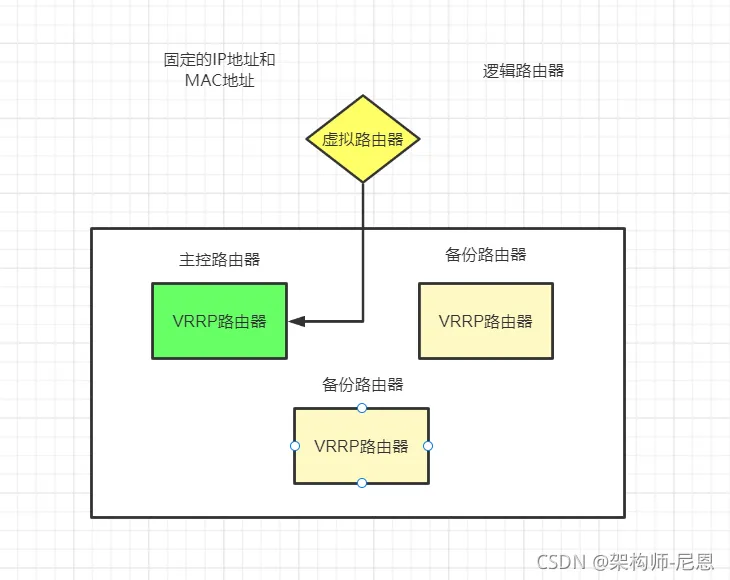

备份路由器(BACKUP):虚拟路由器中的其他物理路由器不拥有对外的虚拟IP,也不对外提供网络功能,仅接受MASTER的VRRP状态通告信息,这些路由器被称为备份路由器。当主路由器失败时,处于BACKUP角色的备份路由器将重新进行选举,产生一个新的主路由器进入MASTER角色,继续提供对外服务,整个切换对用户来说是完全透明的。

虚拟路由器

VRRP路由器(物理实体)

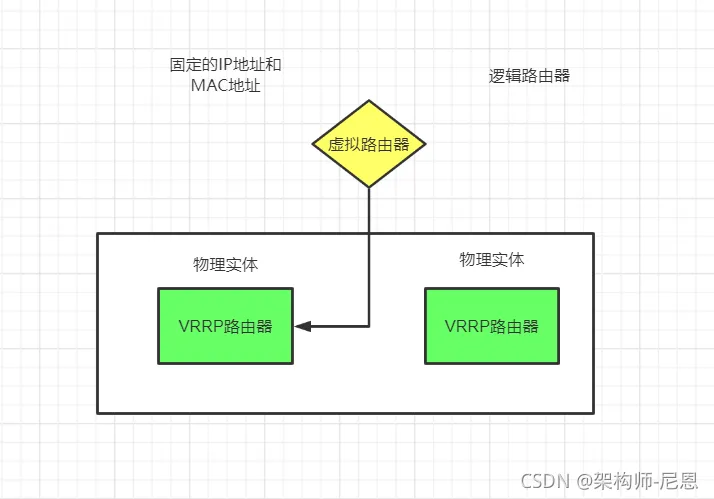

什么是VRRP路由器?

VRRP路由器是指运行VRRP的路由器,是物理实体;

虚拟路由器:

什么是虚拟路由器?

虚拟路由器是指VRRP协议创建的,是逻辑概念。一组VRRP路由器(物理实体)协同工作,共同构成一台虚拟路由器。该虚拟路由器对外表现为一个具有唯一固定的IP地址和MAC地址的逻辑路由器。

虚拟路由器是VRRP备份组中所有路由器的集合,它是一个逻辑概念,并不是正真存在的。从备份组外面看备份组中的路由器,感觉组中的所有路由器就像一个 一样,可以理解为在一个组中: 主路由器+所有备份路由器=虚拟路由器。

虚拟路由器有一个虚拟的IP地址和MAC地址。

主机将虚拟路由器当作默认网关。虚拟MAC地址的格式为00-00-5E-00-01-{VRID}。通常情况下,虚拟路由器回应ARP请求使用的是虚拟MAC地址,只有虚拟路由器做特殊配置的时候,才回应接口的真实MAC地址。

主控路由器主路由器(MASTER):

什么是主控路由器?

处于同一个VRRP组中的路由器具有两种互斥的角色:主控路由器和备份路由器

一个VRRP组中有且只有一台处于主控角色的路由器,可以有一个或者多个处于备份角色的路由器VRRP协议从路由器组中选出一台作为主控路由器,负责ARP解析和转发IP数据包,组中的其他路由器作为备份的角色并处于待命状态。

虚拟路由器通过虚拟IP对外提供服务,而在虚拟路由器内部同一时间只有一台物理路由器对外提供服务,这台提供服务的物理路由器被称为主路由器。一般情况下Master是由选举算法产生,它拥有对外服务的虚拟IP,提供各种网络功能,如:ARP请求,ICMP数据转发等。

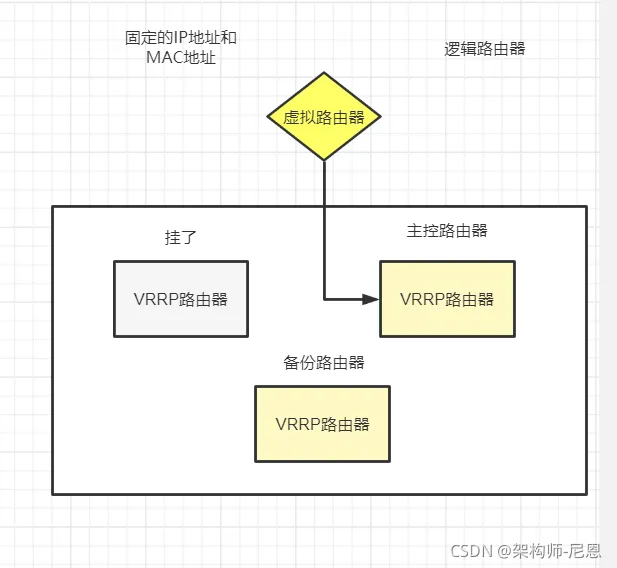

当由于某种原因主控路由器发生故障时,其中的一台备份路由器能在瞬间的时延后升级为主控路由器,由于此切换非常迅速而且不用改变IP地址和MAC地址,故对终端使用者系统是透明的。

一个局域网络内的所有主机都设置缺省路由,当网内主机发出的目的地址不在本网段时,报文将被通过缺省路由发往外部路由器,从而实现了主机与外部网络的通信。

当缺省路由器down掉(即端口关闭)之后,内部主机将无法与外部通信,如果路由器设置了VRRP时,那么这时,虚拟路由将启用备份路由器,从而实现全网通信。

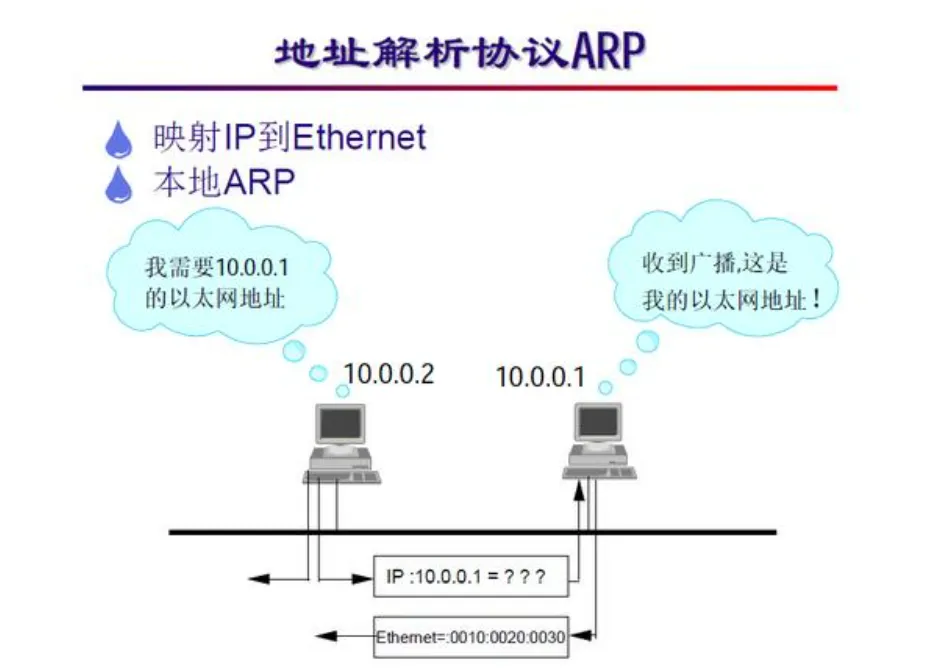

题外话:ARP协议

地址解析协议,即ARP(Address Resolution Protocol),是根据IP地址获取物理地址的一个TCP/IP协议。

主机发送信息时将包含目标IP地址的ARP请求广播到局域网络上的所有主机,并接收返回消息,以此确定目标的物理地址。

arp缓存:收到返回消息后将该IP地址和物理地址存入本机ARP缓存中并保留一定时间,下次请求时直接查询ARP缓存以节约资源。

地址解析协议是建立在网络中各个主机互相信任的基础上的,局域网络上的主机可以自主发送ARP应答消息,其他主机收到应答报文时不会检测该报文的真实性就会将其记入本机ARP缓存;由此攻击者就可以向某一主机发送伪ARP应答报文,使其发送的信息无法到达预期的主机或到达错误的主机,这就构成了一个ARP欺骗。

ARP命令可用于查询本机ARP缓存中IP地址和MAC地址的对应关系、添加或删除静态对应关系等。

相关协议有RARP、代理ARP。NDP用于在IPv6中代替地址解析协议。

ARP协议工作过程

主机A的IP地址为192.168.1.1,MAC地址为0A-11-22-33-44-01;

主机B的IP地址为192.168.1.2,MAC地址为0A-11-22-33-44-02;

当主机A要与主机B通信时,地址解析协议可以将主机B的IP地址(192.168.1.2)解析成主机B的MAC地址,以下为工作流程:

第1步:根据主机A上的路由表内容,IP确定用于访问主机B的转发IP地址是192.168.1.2。然后A主机在自己的本地ARP缓存中检查主机B的匹配MAC地址。

第2步:如果主机A在ARP缓存中没有找到映射,它将询问192.168.1.2的硬件地址,从而将ARP请求帧广播到本地网络上的所有主机。源主机A的IP地址和MAC地址都包括在ARP请求中。本地网络上的每台主机都接收到ARP请求并且检查是否与自己的IP地址匹配。如果主机发现请求的IP地址与自己的IP地址不匹配,它将丢弃ARP请求。

第3步:主机B确定ARP请求中的IP地址与自己的IP地址匹配,则将主机A的IP地址和MAC地址映射添加到本地ARP缓存中。

第4步:主机B将包含其MAC地址的ARP回复消息直接发送回主机A。

第5步:当主机A收到从主机B发来的ARP回复消息时,会用主机B的IP和MAC地址映射更新ARP缓存。本机缓存是有生存期的,生存期结束后,将再次重复上面的过程。主机B的MAC地址一旦确定,主机A就能向主机B发送IP通信了。

VRRP协议选举机制

VRRP路由器在运行过程中有三种状态:

1.Initialize状态:

系统启动后就进入Initialize,此状态下路由器不对VRRP报文做任何处理;

2.Master状态;

3.Backup状态;

一般主路由器处于Master状态,备份路由器处于Backup状态。

VRRP使用选举机制来确定路由器的状态,优先级选举:

1.VRRP组中IP拥有者。如果虚拟IP地址与VRRP组中的某台VRRP路由器IP地址相同,则此路由器为IP地址拥有者,这台路由器将被定位主路由器。 2.比较优先级。如果没有IP地址拥有者,则比较路由器的优先级,优先级的范围是0~255,优先级大的作为主路由器 3.比较IP地址。在没有Ip地址拥有者和优先级相同的情况下,IP地址大的作为主路由器。

如下图所示,虚拟IP为10.1.1.254,在VRRP组中没有IP地址拥有者,则比较优先级,很明显RB和RA的优先级要大于RC,则比较RA和RB的IP地址,RB的IP地址大。

所以RB为组中的主路由器。

选举流程

路由器使用VRRP 功能后,会根据优先级确定自己在备份组中的角色。优先级高的路由器成为Master 路由器,优先级低的成为Backup 路由器。

- Master 拥有对外服务的虚拟IP,提供各种网络功能,并定期发送VRRP 报文,通知备份组内的其他设备自己工作正常;

- Backup 路由器只接收Master 发来的报文信息,用来监控Master 的运行状态。

当Master 失效时,Backup 路由器进行选举,优先级高的Backup 将成为新的Master 。

在抢占方式下,当Backup路由器收到VRRP 报文后,会将自己的优先级与报文中的优先级进行比较。如果大于通告报文中的优先级,则成为Master 路由器;否则将保持Backup状态;

在非抢占方式下,只要Master 路由器没有出现故障,备份组中的路由器始终保持 Master 或Backup 状态,Backup 路由器即使随后被配置了更高的优先级也不会成为Master 路由器;

如果Backup 路由器的定时器超时后仍未收到Master 路由器发送来的VRRP报文,则认为Master 路由器已经无法正常工作,此时Backup 路由器会认为自己是Master 路由器,并对外发送VRRP报文。

备份组内的路由器根据优先级选举出Master 路由器,承担报文的转发功能。

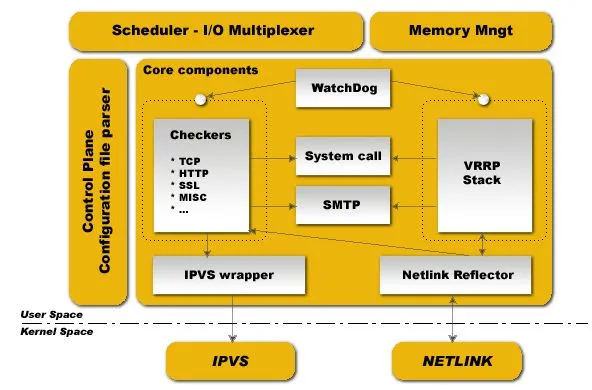

Keepalived体系结构

Keepalived起初是为LVS设计的,由于Keeplalived可以实现对集群节点的状态检测,而IPVS可以实现负载均衡功能,因此,Keepalived借助于第三方模块IPVS就可以很方便地搭建一套负载均衡系统。

在Keepalived当中IPVS模块是可配置的,如果需要负载均衡功能,可以在编译Keepalived时开打负载均衡功能,也可以通过编译参数关闭。

keepalived运行时,会启动3个进程,分别为:core(核心进程),check和vrrp - core:负责主进程的启动,维护和全局配置文件的加载; - check:负责健康检查 - vrrp:用来实现vrrp协议

SchedulerI/OMultiplexer是一个I/O复用分发调度器,它负载安排Keepalived所有内部的任务请求;

Memory Mngt是一个内存管理机制,这个框架提供了访问内存的一些通用方法;

Control Plane 是keepalived的控制版面,可以实现对配置文件编译和解析;

Core componets 这部分主要包含了5个部分;

- Watchdog:是计算机可靠领域中极为简单又非常有效的检测工具,Keepalived正是通过它监控Checkers和VRRP进程的。

- Checkers: 这是Keepalived最基础的功能,也是最主要的功能,可以实现对服务器运行状态检测和故障隔离。

- VRRP Stack: 这是keepalived后来引用VRRP功能,可以实现HA集群中失败切换功能。负责负载均衡器之间的失败切换FailOver;

- IPVS wrapper:这个是IPVS功能的一个实现,IPVSwarrper模块将可以设置好的IPVS规则发送的内核空间并且提供给IPVS模块,最终实现IPVS模块的负载功能。

- Netlink Reflector:用来实现高可用集群Failover时虚拟IP(VIP)的设置和切换

IPVS内核模块

此模块是此文的重点。

Linux 的 IPVS内核模块基本上是一种高效的Layer-4交换机,它提供负载平衡的功能。

ipvs (IP Virtual Server) 实现了传输层负载均衡,也就是我们常说的4层LAN交换,作为 Linux 内核的一部分。

ipvs运行在主机上,在真实服务器集群前充当负载均衡器。

ipvs可以将基于TCP和UDP的服务请求转发到真实服务器上,并使真实服务器的服务在单个 IP 地址上显示为虚拟服务。

当一个TCP连接的初始SYN报文到达时,IPVS就选择一台服务器,将报文转发给它。

此后通过查发报文的IP和TCP报文头地址,保证此连接的后继报文被转发到相同的服务器。这样,IPVS不用检查到请求的内容再选择服务器,这就要求后端的服务器组是提供相同的服务,不管请求被送到哪一台服务器,返回结果都应该是一样的。但是在有一些应用中后端的服务器可能功能不一,有的是提供HTML文档的Web服务器,有的是提供图片的Web服务器,有的是提供CGI的Web服务器。这时,就需要基于内容请求分发 (Content-Based Request Distribution),同时基于内容请求分发可以提高后端服务器上访问的局部性。

当一个TCP连接的初始SYN报文到达时,IPVS就选择一台服务器,将报文转发给它。此后通过查发报文的IP和TCP报文头地址,保证此连接的后继报文被转发到相同的服务器。这样,IPVS无法检查到请求的内容再选择服务器,这就要求后端的服务器组是提供相同的服务,不管请求被送到哪一台服务器,返回结果都应该是一样的。但是在有一些应用中后端>的服务器可能功能不一,有的是提供HTML文档的Web服务器,有的是提供图片的Web服务器,有的是提供CGI的Web服务器。这时,就需要基于内容请求分发 (Content-Based Request Distribution),同时基于内容请求分发可以提高后端服务器上访问的局部性。

Keepalived对服务器运行状态和故障隔离的工作原理

Keepalived工作在TCP/IP参考模型的网络层/传输层/应用层:

网络层:

Keepalived通过ICMP协议向服务器集群中的每一个节点发送一个ICMP数据包(有点类似与Ping的功能),如果某个节点没有返回响应数据包,那么认为该节点发生了故障,Keepalived将报告这个节点失效,并从服务器集群中剔除故障节点。传输层:

Keepalived 在传输层里利用了TCP协议的端口连接和扫描技术来判断集群节点的端口是否正常,比如对于常见的WEB服务器80端口。或者SSH服务22端口,Keepalived一旦在传输层探测到这些端口号没有数据响应和数据返回,就认为这些端口发生异常,然后强制将这些端口所对应的节点从服务器集群中剔除掉。应用层:

Keepalived 的运行方式也更加全面化和复杂化,用户可以通过自定义Keepalived工作方式,例如:

可以通过编写程序或者脚本来运行Keepalived,而Keepalived将根据用户的设定参数检测各种程序或者服务是否允许正常,如果Keepalived的检测结果和用户设定的不一致时,Keepalived将把对应的服务器从服务器集群中剔除。

Keepalived + Nginx 系统架构

在Keepalived + Nginx高可用负载均衡架构中,keepalived负责实现High-availability (HA) 功能控制前端机VIP(虚拟网络地址),当有设备发生故障时,热备服务器可以瞬间将VIP自动切换过来,实际运行中体验只有2秒钟切换时间,DNS服务可以负责前端VIP的负载均衡。

nginx负责控制后端web服务器的负载均衡,将客户端的请求按照一定的算法转发给后端Real Server处理,而Real Server将响应直接返回给客户端。

系统环境

两台负载机器安装:centos7.5+docker+nginx+keepalived,分别命名为:NGINX_MASTER,NGINX_BACKUP。 后端web服务器,可以是提供web服务的任何架构,分别命名为:WEB_1,WEB_2。 后端数据库机器可任意架构,只要能提供数据库服务即可。

| 服务器 | 操作系统 | IP地址 | 安装软件 |

|---|---|---|---|

| NGINX_MASTER | Centos 7.5 64位 | 192.168.2.228 | docker+nginx+keepalived |

| NGINX_BACKUP | Centos 7.5 64位 | 192.168.2.229 | docker+nginx+keepalived |

| WEB_1 | Centos 7.5 64位 | 192.168.2.226 | docker+springboot |

| WEB_2 | Centos 7.5 64位 | 192.168.2.227 | docker+springboot |

| 数据库集群 | Centos 7.5 64位 | mysql集群 |

keepalive的配置文件

vim /etc/keepalived/keepalived.conf

vrrp_script chk_nginx {

script "/etc/keepalived/nginx_pid.sh" # 检查nginx状态的脚本

interval 2

weight 3

}

vrrp_instance VI_1 {

state MASTER #备份服务器上将MASTER改为BACKUP

interface ens32

virtual_router_id 51

priority 100 #备份服务上将100改为小于100,可配置成90

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.2.242 #有多个vip可在下面继续增加

}

track_script {

chk_nginx

}

}

Keepalived的配置文件可以分为三块:

- 全局定义块:对整个 Keepalive 配置生效的,不管是否使用 LVS;

- VRRP 实例定义块:是 Keepalived 的核心;

- 虚拟服务器(LVS)定义块:LVS 配置只在使用 Keepalived 来配置和管理 LVS 时才需要使用,如果仅仅使用 Keepalived做 HA,LVS 的配置完全是不需要的。

配置文件都是以块(block)形式组织的,每个块都在{和}包围的范围内。#和!开头的行都是注释。

部署架构

目的: 进一步提高keepalived 可用性

设计:有3台keepalived 服务器 192.168.1.106 192.168.1.107 192.168.1.108。

vip 是192.168.1.249

效果:只要有一台keepalive 运行正常。vip 就可以访问

| server | hostname | ip |

|---|---|---|

| keepalived | z6 | 192.168.1.106 |

| keepalived | z7 | 192.168.1.107 |

| keepalived | z8 | 192.168.1.108 |

非抢占模式 默认 是谁先开启vip 运行在哪台机器上的。如果发生故障转移,再比较priority

离线部署keepalived

首先安装keepalived,下载离线包的命令为

yum install --downloadonly --downloaddir=./ keepalived

已经提供了安装包,上传安装包到 linux,比如root目录

keepalived_rpm.tar.gz

解压缩,然后执行命令安装

cd /root/

tar -zxvf keepalived_rpm.tar.gz

cd keepalived_rpm

rpm -Uvh --force --nodeps *rpm

输出

[root@localhost ~]# tar -zxvf keepalived_rpm.tar.gz

keepalived_rpm/

keepalived_rpm/keepalived-1.3.5-19.el7.x86_64.rpm

keepalived_rpm/lm_sensors-libs-3.4.0-8.20160601gitf9185e5.el7.x86_64.rpm

keepalived_rpm/net-snmp-agent-libs-5.7.2-49.el7_9.1.x86_64.rpm

keepalived_rpm/net-snmp-libs-5.7.2-49.el7_9.1.x86_64.rpm

安装的输出

[root@localhost ~]# cd keepalived_rpm

[root@localhost keepalived_rpm]# rpm -Uvh --force --nodeps *rpm

warning: keepalived-1.3.5-19.el7.x86_64.rpm: Header V3 RSA/SHA256 Signature, key ID f4a80eb5: NOKEY

Preparing... ################################# [100%]

Updating / installing...

1:net-snmp-libs-1:5.7.2-49.el7_9.1 ################################# [ 25%]

2:lm_sensors-libs-3.4.0-8.20160601g################################# [ 50%]

3:net-snmp-agent-libs-1:5.7.2-49.el################################# [ 75%]

4:keepalived-1.3.5-19.el7 ################################# [100%]

编写nginx的监控脚本

vi /etc/keepalived/check_nginx.sh

#!/bin/bash

A=`ps -C haproxy --no-header |wc -l`

if [ $A -eq 0 ];then

systemctl stop keepalived

fi

添加检查nginx状态的脚本 /etc/keepalived/nginx_pid.sh

#!/bin/bash

##检查nginx.pid文件是否存在

if [ -e /usr/local/nginx/logs/nginx.pid ];then

echo "nginx 已经启动"

else

/usr/local/nginx/sbin/nginx

if [ $? -eq 0 ];then

echo "nginx 已经启动"

fi

fi

或者

#!/bin/bash

##使用ps -C nginx --no-header 来检测nginx 是否启动

date=`date`

nginx_status=`ps -C nginx --no-header|wc -l`

if [ $nginx_status -eq 0 ];then

echo "nginx没有启动"

/usr/local/nginx/sbin/nginx

if [ $? -eq 0 ];then

echo "$date nginx已经成功启动"

fi

else

echo "$date nginx 已经启动 "

fi

上传脚本,测试一下脚本

sh /etc/keepalived/check_nginx.sh

修改keepalived配置

cat /etc/keepalived/keepalived.conf

cp /etc/keepalived/keepalived.conf /etc/keepalived/keepalived.conf.bak

复制 准备好的文件到离线环境,或者直接编辑。

vi /etc/keepalived/keepalived.conf

global_defs { #全局定义部分

notification_email { #设置警报邮箱

acassen@firewall.loc #邮箱1

failover@firewall.loc #邮箱2

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc #设置发件人地址

smtp_server 127.0.0.1 #设置smtp server地址

smtp_connect_timeout 30 #设置smtp超时连接时间 以上参数可以不配置

router_id HA_HAPROXY #是Keepalived服务器的路由标识在一个局域网内,这个标识(router_id)是唯一的

}

vrrp_script check_nginx {

script "/etc/keepalived/check_nginx.sh"

}

vrrp_instance VI_1 { #VRRP实例定义区块名字是VI_1

state BACKUP #表示当前实例VI_1的角色状态这个状态只能有MASTER和BACKUP两种状态,并且需要大写这些字符, MASTER 为正式工作的状态,BACKUP为备用的状态

interface ens33 #绑定ens33网卡

virtual_router_id 101 # VRRP 路由 ID实例,每个实例是唯一的

priority 90 # 优先级,备服务器设置 90

advert_int 1 # 指定VRRP 心跳包通告间隔时间,默认1秒 ,MASTER与BACKUP之间通信检查的时间间隔,

authentication { #authentication为权限认证配置不要改动,同一vrrp实例的MASTER与BACKUP使用相同的密码才能正常通信。

auth_type PASS

auth_pass 1111

}

virtual_ipaddress { #设置虚拟IP地址

# 192.168.31.60/24

172.18.8.231/24

}

track_script {

check_nginx

}

}

Keepalived的配置文件可以分为三块:

- 全局定义块:对整个 Keepalive 配置生效的,不管是否使用 LVS;

- VRRP 实例定义块:是 Keepalived 的核心;

- 虚拟服务器(LVS)定义块:LVS 配置只在使用 Keepalived 来配置和管理 LVS 时才需要使用,如果仅仅使用 Keepalived做 HA,LVS 的配置完全是不需要的。

配置文件都是以块(block)形式组织的,每个块都在{和}包围的范围内。#和!开头的行都是注释。

离线包里边有 第一个节点的 配置文件,复制到 /etc/keepalived/ 目录就行

cp /home/docker-compose/keepalive-ha/keepalived01.conf /etc/keepalived/keepalived.conf

输出如下:

[root@localhost keepalive-ha]# pwd

/home/docker-compose/keepalive-ha

[root@localhost keepalive-ha]# cp /home/docker-compose/keepalive-ha/keepalived01.conf /etc/keepalived/keepalived.conf

cp: overwrite ‘/etc/keepalived/keepalived.conf’? yes

[root@localhost keepalive-ha]# cat /etc/keepalived/keepalived.conf

global_defs {

notification_email { #

mail1@firewall.loc

mail2@firewall.loc

}

重启 keepalive服务

命令如下

# systemctl enable keepalived

# systemctl start keepalived

# systemctl restart keepalived

# systemctl status keepalived

输出如下:

[root@localhost ~]# systemctl enable keepalived

Created symlink from /etc/systemd/system/multi-user.target.wants/keepalived.service to /usr/lib/systemd/system/keepalived.service.

[root@localhost ~]# systemctl restart keepalived

[root@localhost ~]# systemctl status keepalived

● keepalived.service - LVS and VRRP High Availability Monitor

Loaded: loaded (/usr/lib/systemd/system/keepalived.service; enabled; vendor preset: disabled)

Active: active (running) since Fri 2021-11-05 13:28:30 CST; 19s ago

Process: 48837 ExecStart=/usr/sbin/keepalived $KEEPALIVED_OPTIONS (code=exited, status=0/SUCCESS)

Main PID: 48838 (keepalived)

Tasks: 3

Memory: 3.4M

CGroup: /system.slice/keepalived.service

├─48838 /usr/sbin/keepalived -D

├─48839 /usr/sbin/keepalived -D

└─48840 /usr/sbin/keepalived -D

Nov 05 13:28:34 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:34 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:34 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:34 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:39 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:39 localhost.localdomain Keepalived_vrrp[48840]: VRRP_Instance(VI_1) Sending/queueing gratuitous ARPs on ens33 ...1.60

Nov 05 13:28:39 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:39 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:39 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Nov 05 13:28:39 localhost.localdomain Keepalived_vrrp[48840]: Sending gratuitous ARP on ens33 for 192.168.31.60

Hint: Some lines were ellipsized, use -l to show in full.

查看IP

[root@localhost ~]# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000

link/ether 00:0c:29:69:a4:84 brd ff:ff:ff:ff:ff:ff

inet 172.18.8.101/24 brd 172.18.8.255 scope global noprefixroute ens33

valid_lft forever preferred_lft forever

inet 172.18.8.231/24 scope global secondary ens33

valid_lft forever preferred_lft forever

inet6 fe80::b7be:346e:2f0f:859e/64 scope link noprefixroute

valid_lft forever preferred_lft forever

访问高可用代理后的nacos

高可用代理

http://172.18.8.231:28848/nacos/#/configurationManagement?dataId=&group=&appName=&namespace=

用户名:nacos ,密码 nacos

第2个节点,第3个节点离线部署keepalived

复制文件/并且安装

scp /root/keepalived_rpm.tar.gz root@172.18.8.103:/root

scp /root/keepalived_rpm.tar.gz root@172.18.8.104:/root

解压缩,然后执行命令安装

cd /root/

tar -zxvf keepalived_rpm.tar.gz

cd keepalived_rpm

rpm -Uvh --force --nodeps *rpm

把离线包里的 keepalive-ha 传过去,然后复制到 /etc/keepalived/

第1个节点,执行

cp /home/docker-compose/keepalive-ha/keepalived01.conf /etc/keepalived/keepalived.conf

cp /home/docker-compose/keepalive-ha/check_haproxy.sh /etc/keepalived/

cat /etc/keepalived/keepalived.conf

第二个节点,执行

cp /home/docker-compose/keepalive-ha/keepalived02.conf /etc/keepalived/keepalived.conf

cp /home/docker-compose/keepalive-ha/check_haproxy.sh /etc/keepalived/

cat /etc/keepalived/keepalived.conf

输出如下:

[root@localhost keepalive-ha]# cp /home/docker-compose/keepalive-ha/keepalived02.conf /etc/keepalived/keepalived.conf

cp: overwrite ‘/etc/keepalived/keepalived.conf’? yes

[root@localhost keepalive-ha]# cp /home/docker-compose/keepalive-ha/check_haproxy.sh /etc/keepalived/

cp: overwrite ‘/etc/keepalived/check_haproxy.sh’? yes

第3个节点,执行

cp /home/docker-compose/keepalive-ha/keepalived03.conf /etc/keepalived/keepalived.conf

cp /home/docker-compose/keepalive-ha/check_haproxy.sh /etc/keepalived/

cat /etc/keepalived/keepalived.conf

输出如下:

cp /home/docker-compose/keepalive-ha/keepalived03.conf /etc/keepalived/keepalived.conf

cp: overwrite ‘/etc/keepalived/keepalived.conf’? yes

[root@k8s-master keepalived_rpm]# cp /home/docker-compose/keepalive-ha/check_haproxy.sh /etc/keepalived/

cp: overwrite ‘/etc/keepalived/check_haproxy.sh’? yes

重启 keepalive服务

命令如下

systemctl enable keepalived

systemctl start keepalived

systemctl restart keepalived

systemctl status keepalived

systemctl stop keepalived

查看IP地址

ip a

ip a | grep ens33

ifconfig ens33

输出结果

[root@localhost ~]# ip a

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: ens33: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000

link/ether 00:0c:29:69:a4:84 brd ff:ff:ff:ff:ff:ff

inet 172.18.8.101/24 brd 172.18.8.255 scope global noprefixroute ens33

valid_lft forever preferred_lft forever

inet 172.18.8.231/24 scope global secondary ens33

valid_lft forever preferred_lft forever

inet6 fe80::b7be:346e:2f0f:859e/64 scope link noprefixroute

valid_lft forever preferred_lft forever

测试高可用

停止101上的haproxy

sh ./stop_node.sh

sh ./start_node.sh

输出

[root@localhost haproxy-ha]# sh ./stop_node.sh

===========stoping haproxy-ha .....================

WARNING: Some services (ha_sit_proxy) use the 'deploy' key, which will be ignored. Compose does not support 'deploy' configuration - use `docker stack deploy` to deploy to a swarm.

Stopping ha_sit_proxy ... done

Removing ha_sit_proxy ... done

Network ha-network-overlay is external, skipping

访问vip的ng

http://172.18.8.231:80/

可以正常访问

访问vip的nacos (假设已经安装nacos)

http://172.18.8.231:28848/nacos/#/login

可以正常访问

访问高可用代理的minio(假设已经安装minio)

高可用代理

http://172.18.8.231:29991/minio/

用户名:nacos ,密码 nacos

本文转载自:40岁老架构师尼恩

本文链接: https://erik.xyz/2024/01/19/nginx-gaokeyongiptioayue/

版权声明: 本作品采用 知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 进行许可。转载请注明出处!

tag:

- php扩展

- php技巧

- php类库

- php资源

- 日志

- 工具

- jquery

- jquery插件

- js

- css

- php

- web

- 代码

- 压缩

- php服务器

- 随笔

- php实例

- 说说

- 趣闻

- nginx

- 转载

- php库

- javascript

- 漏洞

- php应用

- 浮点

- http

- http服务器

- 负载均衡

- kali

- kali安装

- 克莱姆法则

- 行列式

- n阶行列式

- 支付系统

- 支付

- centos

- linux

- 日常

- apache优化

- apache隐藏index

- nginx优化

- nginx隐藏index

- seo

- 优化

- 摘要

- 文章

- 游记

- ca证书

- 证书生成

- 二战

- 二战熊

- 西伯利亚熊

- centos软件

- yum仓库

- 软件

- svn

- 代码提交

- centos安装chromium报错

- chromium安装报错

- deb

- deb/rpm互转

- deb转rpm

- rpm互转

- centos7安装steam

- centos安装steam

- centos安装吃鸡steam

- linux安装steam

- steam安装

- centos软件安装

- centos6.5

- linux系统

- centos7安装Redis Desktop Manager

- centos7安装redis桌面

- centos安装redis桌面

- linux安装centos7安装Redis Desktop Manager

- Redis Desktop Manager

- redis桌面

- centos7

- centos7-wine

- wine

- wine安装

- root密码

- root密码重置

- 忘记root密码

- memcache

- memcached

- 生活手记

- 艾瑞可erik

- 程序员

- 开源云

- 容器

- cncf

- 监控

- cphalcon

- cphalcon报错

- css中的em

- 响应式字体

- 响应式布局样式

- proxy代理搭建

- 代理服务器搭建

- proxy服务器

- 查找

- 排序

- 快速排序

- 冒泡排序

- 二分查找

- datahub

- datahub安装

- dns

- 域名监测

- 网站监测

- docker

- php安装

- 杂谈

- ecshop

- 框架

- beego数据分页

- 分页

- elasticsearch

- elasticsearch搭建

- elasticsearch集群

- phone

- 手机

- 新闻

- 免费

- 分布式

- 系统

- 随笔吐槽

- 算法

- ping

- ping服务器

- 各大网站ping

- 搜引擎ping服务器

- go获取ip

- go中pdf生成

- go中限流

- go对接快递签名

- go时间获取

- go类型转换

- 微服务

- go-zero

- rpc

- go加密

- go解密

- 归

- 吐槽

- php大全

- php资料

- hadoop

- hadoop2.8.0

- hadoop安装教程

- hadoop安装详细教程

- hadoop教程

- hadoop部署

- hadoop3

- hadoop配置

- log4j2

- 数据库

- hbase安装教程

- hbase

- http1.1

- http2.0

- 会话

- 会话原理

- hyperf

- 杂录

- 新冠肺炎

- linux恢复

- linux误删

- linux命令

- linux命令汇总

- jenkins

- jetbtrains

- phpstorm

- 搜索引擎

- 图片

- 素材

- jq

- jq侧边导航

- 侧边导航

- js判断浏览器

- js判断浏览器版本

- 判断浏览器

- 浏览器版本判断

- 获取浏览器信息

- kali右键汉化

- kali桌面右键汉化

- kali右键创建文件

- 区块链

- lanmp

- php环境独立配置

- 服务器

- 劳动纠纷

- 追缴工资

- 申请仲裁

- flash

- 表单

- linux报错

- linux中update-command-not-found

- linux运行命令报错

- 撮合算法

- 撮合

- php撮合算法

- 高级缓存配置

- mongodb

- mongodb权限

- 可穿戴设备

- mysql

- 分库分表

- mysql应对千万级

- mysql瓶颈

- mysql瓶颈解决办法

- mysql消息

- mysql队列

- mysql高并发

- mysql存储

- mysql引擎

- mysql数据表设计选择

- mysql监控

- mysql性能

- 内网支付

- 内网穿透

- 支付接口本地化开发

- 本地挂网

- 穿透

- go

- new和make的区别

- 红包算法

- ip跳跃

- ip漫游

- 深圳劳动法服务部门

- 非关系型数据库

- onethink

- oop

- php管理系统

- 开放接口开发

- openresty

- openvas

- openvas安装

- php变量

- php超级全局变量

- php超级变量

- php基本类型

- php数据类型

- php设计模式

- php对接微信支付

- 微信支付

- 微信支付回调

- php函数

- php随机数

- php获取闰年

- 闰年.php时间

- php环境

- php集成环境

- 服务器集成环境

- 数组函数

- 数组排序函数

- php数学函数

- php面试题

- php面向对象

- 面向对象

- php-zookeeper

- zookeeper3.5.5

- php-zookeeper扩展

- php倒计时

- php时间

- 倒计时

- 计算时间

- PHP数组

- 字符串函数

- 排序函数

- php的SPL

- SPL手册

- PHP算法

- php递归

- 递归

- phpunit

- phpunit安装

- php过滤

- 过滤

- foreach

- foreach报错

- php中foreach报错

- php中if

- php中if判断

- php的if

- php字符串

- php7中sphinx

- php7中sphinx扩展

- sphinx扩展

- python

- python库

- a标签

- a标签虚线

- 虚线框

- R语言

- 数据随机化算法

- 随机化

- redis

- redis总结

- redis命令

- redis监控

- redis锁

- redis分布式锁

- 任意金额输入

- 10元、5元、2元

- 队列

- 栈

- 顺序表

- 链表

- 数据结构

- 线性结构

- 响应慢

- 页面优化

- js编辑

- runjs

- 在线编辑

- rust

- rust配置

- seajs

- session

- 路由器烧录

- 烧录

- 极路由2烧录

- 砖头烧录

- 免费服务器

- 空间

- 资源

- 深圳政府电话

- 深圳电话

- 特区电话

- 居住证

- 居住证签注

- 深圳新居住证

- 国庆骑行

- 深圳珠海骑行

- 骑行

- 世界那么大

- css3

- css在线生成工具

- css工具

- php正则

- 正则

- shodan

- 黑谷歌

- 黒帽搜素

- shopex

- 可视化数据

- 数据

- 数据表

- socket通信

- socket多进程

- socket

- json

- json数组

- json解析

- css3兼容360浏览器兼容模式

- css圆角

- 结构体转map

- config

- thinkphp

- 配置文件

- 树

- 二叉树

- js插件

- web自适应

- 响应式布局

- 响应式所有分辨率

- 自适应布局

- 自适应所有分辨率

- mysql设置超时,超时

- markdown

- wget

- wget抓取

- 网站抓取

- 我在

- wordpress

- wordpress标签

- 域名合并

- wpscan

- usbrip

- 无限极分类

- php无限极

- 分类tree

- 无限极分类树型

- xhprof

- webman

- laravel

- composer

- composer插件

- html

- 响应式分辨率

- 响应式调试

- 自适应屏幕

- 携程

- 携程攻击

- 携程网站瘫痪

- 物理删除

- 3D

- 动画

- 平台

- 游戏

- 虚幻4引擎编辑

- 生成唯一id

- 生成id

- 发邮件

- 邮件函数

- 储蓄卡免年费

- 银行卡

- 银行卡免年费

- composer安装

- composer配置

- 项目创建composer

- mysql优化

- mysql读写优化

- 数据库优化,mysql语句优化

- php加密

- php技术

- 夕阳

- mysql函数

- php中mysql函数

- 互联网时代

- 开源技术

- web框架

- php抓取图片

- php批量抓取页面图片

- 邮箱服务器

- 正则表达式

- 翻墙

- 谷歌

- 谷歌搜索

缺失模块。

1、请确保node版本大于6.2

2、在博客根目录(注意不是yilia根目录)执行以下命令:

npm i hexo-generator-json-content --save

3、在根目录_config.yml里添加配置:

jsonContent:

meta: false

pages: false

posts:

title: true

date: true

path: true

text: false

raw: false

content: false

slug: false

updated: false

comments: false

link: false

permalink: false

excerpt: false

categories: false

tags: true

本文链接: https://erik.xyz/2024/01/19/nginx-gaokeyongiptioayue/

版权声明: 本作品采用 知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 进行许可。转载请注明出处!